¿Quién demonios está amenazando a Allison Nixon y por qué?

Abril de 2024, un par de cuentas con nombres ridículos — “Waifu” y “Judische” — empiezan a intentar ponerle un susto de muerte a Allison Nixon. ¿Y quién es Nixon? Pues la cabecilla de investigación en Unit 221B, un grupo de ciberdelincuencia que no se anda con chiquitas: llevan años cazando piratas digitales y metiéndolos tras las rejas. Pero ahora el pastel se complica porque este par de personajes, tras años de estar aparentemente inactivos, de repente deciden que Nixon es su objetivo preferido.

Vale, pero si Nixon estaba persiguiendo a otros criminales digitales, ¿por qué estos sujetos deciden aparecer justo ahora con amenazas serias? Aquí está lo curioso: “Waifu” había estado en el radar de Nixon, sí, pero para delitos que él mismo presumía haber hecho. No es que acabara de nacer como amenaza. Sin embargo, el giro es ese misterio sin resolver: ¿qué le ha hecho Nixon para pasar de ignorarlo a ser objetivo de amenazas? Y ojo, que ella no piensa quedarse de brazos cruzados: quiere desenmascarar a “Waifu” y “Judische” y que paguen no solo por las amenazas sino por todo lo que ellos mismos han admitido haber hecho.

Un dato importante en esta historia es que usar plataformas como Telegram y Discord para lanzar amenazas no es casual: son espacios donde la anonimidad reina, y esta gente aprovecha cada rincón oscuro de internet para esconderse y, a la vez, sembrar miedo. Que alguien así sea un dolor de cabeza para una experta como Nixon dice mucho del nivel de impunidad con el que se mueven estos personajes. Por supuesto, esto abre el debate sobre la responsabilidad de estas plataformas. Que a día de hoy sigan siendo refugio para este tipo de cobardes digitales es una vergüenza. Y mientras tanto, gente como Nixon hace de tripas corazón, metiendo cara en la lucha contra un enemigo al que le encanta jugar al gato y al ratón.

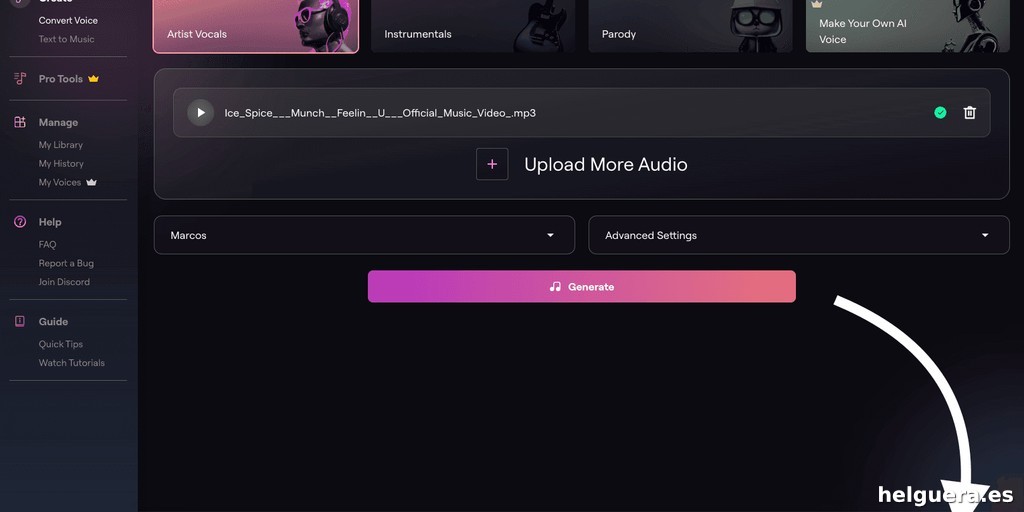

“Perdí mi voz, pero no dejé que me robaran la música”. Eso podría ser la consigna no oficial de Patrick Darling, un tipo que tiene 32 años y una historia que parece sacada de un guion de ciencia ficción. Diagnóstico de esclerosis lateral amiotrófica (ELA) a los 29, una enfermedad cruel que paraliza lentamente todos los músculos, incluyendo los que permiten hablar y cantar. Así, sin previo aviso, Darling se vio inhabilitado para subirse a un escenario, tocar la batería y, lo que más le dolía, cantar.

Patrick Darling y el milagro (digital) de cantar otra vez

¿Y la solución? Pues bueno, no es magia, pero casi: inteligencia artificial. Darling pudo tomar grabaciones viejas y entrenar un modelo de IA para recrear su voz, no solo para que otros la escucharan, sino para que él mismo volviera a componer y, de algún modo, a expresarse. Esto no es cualquier cosa. La IA le ha devuelto la identidad musical, ha traducido la memoria sonora en algo real, tangible y vivo. Y cuando esa primera canción resonó, dedicada a su bisabuelo nunca conocido, el público no pudo evitar emocionarse. ¿Quién no se emocionaría ante un renacer tan tecnológico como humano? Pero ojo, que esto no es solo una historia bonita de superación personal mediante herramientas digitales ni un intento más de vender la inteligencia artificial como el héroe del día. Aquí hay preguntas densas: ¿qué significa que una máquina cree «la voz» de alguien? ¿Dónde queda el artista original? ¿Podría en algún momento la tecnología usurpar ese rol? Darling, afortunadamente, controla el proceso y usa la IA como extensión de sí mismo, no como reemplazo, pero la línea es fina y vale la pena debatirla.

Si Darling suena a cuento casi feliz, no todo el mundo está encantado con el tema de la voz digital. David Greene, un locutor de radio, por ejemplo, no está para nada contento con Google. La razón: cree que el gigante tecnológico le «robó» la voz. Su demanda legal contra Google por usar una voz generada por IA que, supuestamente, imita sus características vocales sin permiso tiene implicaciones enormes.

Esta batalla no es un capítulo aislado. Más personas, principalmente artistas y profesionales cuya voz es su identidad, están empezando a ver que la tecnología puede cruzar líneas del todo insospechadas hasta ahora. Google, en su famoso NotebookLM, implementó un motor de voz AI que a ojos de Greene invade espacios privados y, encima, genera dinero sin darle un solo centavo. El problema es que la legislación tecnológica va siempre varias vueltas atrás de lo que se desarrolla en el laboratorio y por eso este tipo de peleas acaban siendo un campo minado jurídico y ético.

De jugadas legales y artistas que ven robadas sus voces digitales

¿Deberían las grandes tecnológicas pedir permiso para replicar tu voz? ¿Las voces entrenadas con IA pueden considerarse tu propiedad intelectual? La cuestión es que, si ni siquiera hay una regulación clara, la respuesta por ahora es “depende”. Pero no cabe duda: estamos en la era donde la voz humana es un activo digital más y lo que parecía impensable hace unos años hoy es un enfrentamiento legal real.

Si alguien piensa que la IA es sólo un código aburrido, que mire lo que Sam Altman está haciendo con Peter Steinberger y su OpenClaw. Resulta que este último llegó con ideas tan chulas que OpenAI se ha puesto las pilas para que agentes de inteligencia artificial puedan interactuar y colaborar entre sí sin necesidad de intermediarios humanos.

La movida suena a escena sacada de una película de ciencia ficción: ‘bots’ que negocian, diagnostican problemas o incluso crean estrategias en tiempo real pero sin que nadie controle el flujo de información. OpenAI se está tomando en serio esta idea (y cómo no si están en una carrera desenfrenada por el dominio del mercado de agentes de IA). Pero ojo, no todo es brillo, también hay mucho teatro en esto — algo que MIT Technology Review llama “peak AI theater”— donde la promesa y la realidad no siempre coinciden. Este avance sin duda va a cambiar la forma en que usamos la IA. Pero difícilmente será tan fluido, confiable y milagroso como prometen los titulares. El reto real no es que los agentes hablen entre sí, sino que sus decisiones y datos sean transparentes y éticos, porque, de lo contrario, podríamos tener un mini infierno digital comunicándose sin control.

OpenAI y el teatro AI: cuando los agentes empiezan a hablar entre ellos

Al ritmo que va la tecnología, uno debería aprender la regla de oro: sorprenderse, pero sin caer en el pánico. Por ejemplo, que alguien crea que el logo de Fruit of the Loom tiene un cuerno de la abundancia es para echarse a reír… y luego preguntarse qué diablos está pasando con los recuerdos colectivos (la famosa “Mandela effect”). Pero, a nivel tecnológico es interesante porque demuestra lo fácil que es que la realidad se distorsione, algo que la IA explota a placer replicando mundos falsos.

También tenemos a Google restando importancia a las advertencias sobre consejos médicos generados por IA, mostrando esas alertas sólo si pulsas “Mostrar más”. ¿Cómo nos fiamos entonces de una herramienta que puede darnos un diagnóstico brillante o un error potencialmente fatal? La cuestión es que los gigantes de la tecnología ponen el negocio por encima de la seguridad, y nosotros, a esa velocidad, sólo podemos tener prejuicio saludable y escepticismo.

¿Y qué me dicen de los dirigentes de la industria automotriz en EE.UU. muriéndose de miedo ante la posibilidad de que fabricantes chinos pongan fábricas en suelo americano? Pues es algo que va a pasar, guste o no, porque China ya se ha comido el mercado eléctrico y la disponibilidad de baterías es la única verdadera piedra en su zapato. Pero vamos, que si la política no mete las zarpas, va a ser un cambio de mercado brutal. Que la IA revoluciona todo, nadie lo pone en duda. Pero entre hype y hype, vale la pena bajar a tierra y preguntarse qué está realmente “listo para el consumo” y qué es simple humo tecnológico. Tomemos los videojuegos: la promesa de que la IA va a hacer los juegos «mejores y más inmersivos» suena bien, pero Google DeepMind y Gemini no han arreglado todavía muchos de los problemas clásicos de la industria. Por ejemplo, en simuladores tipo Goat Simulator 3 que entrena agentes con IA, el resultado es divertido, pero ni por asomo “revolucionario”. Los NPCs pueden actuar un poco más naturales, pero la verdadera chispa, la que hace que un juego se convierta en leyenda, sigue dependiendo de ideas humanas que ningún algoritmo puede reemplazar por completo todavía.

El rincón de ‘cosas que… ¿en serio?’ y otras perlas del día

Por último, una cosa está clara: la tecnología avanza a ritmo brutal, pero la ética, la regulación y la sensatez a menudo van en dirección contraria. Y si no controlamos cómo la IA se aplica, en temas desde la robótica, la música, la identidad hasta la seguridad cibernética, nos arriesgamos a crear un monstruo desconectado de quienes debería servir. La pregunta es si vamos a tener cintura para manejar esto, o seremos los payasos de un circo digital con pocas risas y muchos sustos.

También tenemos a Google restando importancia a las advertencias sobre consejos médicos generados por IA, mostrando esas alertas sólo si pulsas “Mostrar más”. ¿Cómo nos fiamos entonces de una herramienta que puede darnos un diagnóstico brillante o un error potencialmente fatal? La cuestión es que los gigantes de la tecnología ponen el negocio por encima de la seguridad, y nosotros, a esa velocidad, sólo podemos tener prejuicio saludable y escepticismo.

¿Y qué me dicen de los dirigentes de la industria automotriz en EE.UU. muriéndose de miedo ante la posibilidad de que fabricantes chinos pongan fábricas en suelo americano? Pues es algo que va a pasar, guste o no, porque China ya se ha comido el mercado eléctrico y la disponibilidad de baterías es la única verdadera piedra en su zapato. Pero vamos, que si la política no mete las zarpas, va a ser un cambio de mercado brutal.

¿Se va la IA a la luna o se estrella en la atmósfera?

Que la IA revoluciona todo, nadie lo pone en duda. Pero entre hype y hype, vale la pena bajar a tierra y preguntarse qué está realmente “listo para el consumo” y qué es simple humo tecnológico.

Tomemos los videojuegos: la promesa de que la IA va a hacer los juegos «mejores y más inmersivos» suena bien, pero Google DeepMind y Gemini no han arreglado todavía muchos de los problemas clásicos de la industria. Por ejemplo, en simuladores tipo Goat Simulator 3 que entrena agentes con IA, el resultado es divertido, pero ni por asomo “revolucionario”. Los NPCs pueden actuar un poco más naturales, pero la verdadera chispa, la que hace que un juego se convierta en leyenda, sigue dependiendo de ideas humanas que ningún algoritmo puede reemplazar por completo todavía.

Por último, una cosa está clara: la tecnología avanza a ritmo brutal, pero la ética, la regulación y la sensatez a menudo van en dirección contraria. Y si no controlamos cómo la IA se aplica, en temas desde la robótica, la música, la identidad hasta la seguridad cibernética, nos arriesgamos a crear un monstruo desconectado de quienes debería servir. La pregunta es si vamos a tener cintura para manejar esto, o seremos los payasos de un circo digital con pocas risas y muchos sustos.

Artículos Relacionados

The Download: AI-enhanced cybercrime, and secure AI assistants

Más información sobre ALS stole this musician’s

Descubre the download: inside the quitgpt movement, and evs in africa