¿Y estos trabajadores pueden enseñar a los robots? Pues sí, y desde su casa

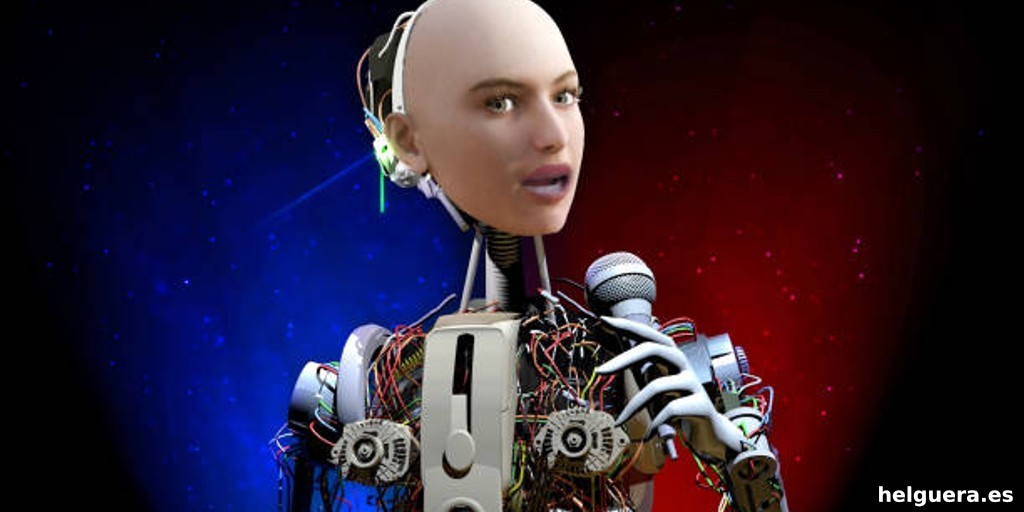

Zeus, un estudiante de medicina en Nigeria, termina su turno en el hospital, llega a su apartamento, coloca un iPhone en su frente y se graba haciendo las tareas del hogar. No es un influencer fitness ni un loco por TikTok. Zeus es un «data recorder» para Micro1, la empresa que vende esas grabaciones a compañías de robótica que están en plena carrera por construir humanoides. Miles de personas en más de 50 países (India, Nigeria, Argentina) hacen esto, cobrando bien para sus economías locales, mientras proveen los datos necesarios para que los robots aprendan cómo hacer lo que hace un humano en el día a día. Lo que suena futurista y cool tiene detrás temas espinosos: privacidad, consentimiento informado, condiciones de trabajo — que no se cuentan entre lo más glamoroso del empleo remoto. La cosa no es simplemente que te grabes, sino que tus movimientos y comportamientos van al crucigrama gigante de la IA para que los bots imiten a los humanos. ¿Qué tan ético es exponer tu rutina, y a qué precio?

Micro1 ha logrado contratar a miles de estos micro-trabajadores globales, y el modelo está tomando vuelo porque a las empresas les sale más barato externalizar experiencia humana que desarrollar esa costosa IA desde cero. Pero no es oro todo lo que reluce: esta “gig economy” robotizada podría convertirse en algo tan explotador como otros trabajos digitales que prometen libertad pero entregan precariedad. Que un chico en Brasil o India esté generando datos para que Boston Dynamics o alguna startup levante un robot no es mala idea en sí, pero ¿quién controla el valor final que obtienen estas personas? Quizá algo de esto explica por qué los humanoides fueron elegidos por los lectores de MIT Technology Review como el “11º breakthrough” para su lista de tecnologías que cambiarán el juego en 2026.

Ahí lo tienes: el futuro de los robots, pulido en apartamentos remotos, mientras compites con Zeus haciendo la colada para construir el Atlas del mañana.

Benchmark de IA: ¿Por qué los números que nos dan son un embuste?

Desde siempre, la inteligencia artificial se evalúa a base de estadísticas y tests en laboratorios: ¿Puede un programa vencer a un humano en ajedrez? ¿Reconoce imágenes mejor que nosotros? Pero esto es como medir a un atleta en una cinta de correr cuando en la vida real debe jugar un partido de fútbol bajo lluvia, con rivales echándoselo todo encima. Los benchmarks clásicos — tan amados por investigadores y periodistas — ignoran la realidad de la IA, que está puesta a prueba en entornos caóticos, trabajos en equipo con personas y sistemas que cambian minuto a minuto. En la práctica, las IA no funcionan aisladas ni con un script fijo; interactúan, negocian, crean y aprenden en tiempo real, o deberían.

Angela Aristidou, profe en University College London y ficha del Stanford Human-Centered AI Institute, propone un cambio de paradigma urgente: pasar a un modelo llamado Human–AI, Context-Specific Evaluation. Ese nombre ya suena más a ciencia ficción, pero es la medicina que la IA necesita. En vez de medir cuánto brilla un algoritmo en test sintéticos, hay que evaluarlo en cómo colabora con humanos, aporta valor en flujos de trabajo reales, y se adapta a contextos complejos y dinámicos. ¿Parece complicado? Lo es. Pero sin esto, seguimos con un espejismo que, como en la burbuja de las puntocom, vende una idea de IA “infalible” que llega a la calle para luego causar más problemas que soluciones.

Si tu chatbot no entiende tu dialecto, o tu robot falla cuando hay más de dos personas en la escena, no importa que en laboratorio “haya sacado 99% de precisión”. Hay que deshacerse de esa fría estadística y mirar la experiencia completa: humanos y máquinas, juntos.

¿Quantum y salud? El siguiente desafío para computadoras que parecen de otro planeta

En Oxford, no muy lejos del tráfico y las pubs, una computadora cuántica — pequeña, potente, y extraña — espera cambiar el juego. No es una laptop cualquiera, sino un aparato que usa átomos y luz para procesar información de maneras que un clásico PC ni sueña. Infleqtion es la startup que la tiene y la juega fuerte para ganar un premio de cinco millones de dólares destinado a quien pueda resolver problemas médicos con esta tecnología. Nada de trivialidades: el reto es que la computadora cuántica haga cosas que las máquinas normales no pueden.

La promesa de la computación cuántica en medicina es espectacular: analizar millones de configuraciones moleculares, entender interacciones complejas de fármacos, optimizar tratamientos personalizados, y acelerar descubrimientos que ahora llevan años. Pero hay una tara enorme: todavía está en pañales, fallando, y con un futuro incierto. Por ahora, el concurso se entiende como una prueba de fuego. O ganas el oro o no hay para nadie. ¿Será incapaz de entregar resultados revolucionarios? ¿O nos sorprenderá inesperadamente?

Mientras tanto, este tipo de iniciativas son vitales para filtrar hype barato del avance real. ¿En serio necesitamos que la carrera cuántica continúe con verborrea marketing? Sí, pero solo si la nueva generación de máquinas puede hacer más que números en papel.

OpenAI y su guerra por la pasta: ¿Un monopolio o un futuro?

OpenAI no solo está chupando la atención mediática. Acaba de cerrar una ronda de financiación que bate récords en Silicon Valley: 12.2 mil millones de dólares. No, no me equivoqué con los ceros. Esta inyección brutal llega antes de su esperado IPO para finales de año y marca una jugada estratégica para reinventar lo que llaman “el contrato social” con la IA. Eso suena abstracto, pero básicamente significa que OpenAI quiere meterle control y regulación a lo que ellos mismos están lanzando al mundo.

Como todo gigante, la controversia no se queda atrás. Activistas y expertos piden dejar de usar ChatGPT; que cese la adicción y dependencia en estas plataformas. Se cuestionan desde la ética hasta la privacidad, pasando por el impacto laboral (y no veremos pronto a un robot como Zeus sustituyendo estudiantes de medicina, pero ojo). OpenAI está en una cuerda floja: o lidera con responsabilidad, o se convierte en la versión moderna de un monopolio tecnológico que ahoga innovación y vigilancia pública.

Ah, y no es solo palabrería de Silicon Valley: Irán ya advierte que tiene en la mira a 18 compañías tecnológicas estadounidenses — incluyendo los pesos pesados Nvidia, Apple y Google — con ataques e interrupciones. La guerra tech global está encendida y la geopolítica invisible que mueve chips y datos es más real que tus mensajes de WhatsApp.

El caos invisible: lo que no ves cuando tu robotaxi se apaga en Wuhan

Imagina viajar por Wuhan (China) y que tu robotaxi se quede congelado en medio de la calle. Eso pasó. Flotas enteras de vehículos inteligentes de Baidu dejaron a pasajeros dando vueltas, bloqueando la ciudad, y sumando padres desesperados. ¿El culpable? Un “fallo en el sistema”, dicen las autoridades. La realidad es más enrevesada: miles de vehículos dependientes de software complejo, redes inestables y decisiones automáticas que pueden, en un instante, pararte en seco.

Por si fuera poco, Tesla salió a admitir que sus robotaxis a veces necesitan intervención humana directa. Lejos de la “conducción 100% autónoma” que venden en los eventos y la publicidad. Palabras textuales: «los conductores remotos controlan algunos vehículos ocasionalmente». Una curiosa confesión que conecta con el desastre en China (sí, todos sabemos que las máquinas pueden malfuncionar, pero ¿dónde está la línea entre “demasiado automatizado” y “aún lo manejamos con seguridad humana”?).

Entre tanto, la vigilancia del gobierno estadounidense a usuarios en redes sociales no para de crecer (770% en la última década). ¿Contrapunto? El debate salta: ¿El Pentágono puede espiar ciudadanos con IA sin supervisión? Y el ecosistema digital se enreda entre control, privacidad, y libertades que ya empezamos a perder sin previo aviso.

¿Y mientras tanto, qué pasa fuera de la pantalla?

Un respiro: mientras algunas noticias son tecnoparanoias, la humanidad sigue haciendo cosas que sorprenden. En Minnesota, una mina de níquel podría valer 26 mil millones en subsidios gracias a la Ley de Reducción de la Inflación (sí, ese nombre que suena a burocracia en realidad es el que impulsa la nueva economía verde). ¿Por qué importa? El níquel es clave en baterías para coches eléctricos. Así que aquí, desde ese suelo helado, se está gestando un futuro energético con dólares reales, no solo hype de Silicon Valley.

En otro lado, la vida sigue con sus rarezas más adorables: unos glotones que probaron casi todas las patatas fritas del mundo (y sobrevivieron), pingüinos que usan piedritas para hacer propuesta de matrimonio, y… terrorismo global en mínimos de 15 años. Aunque la tecnología aceche y enrede, de vez en cuando, la naturaleza y la humanidad recuerdan que todavía es nuestro mundo – hasta que no lo sea.

¿Para qué sirve todo esto, si ni siquiera entendemos bien la IA?

El asunto central, dejando las hypeadas rondas de financiación y la ciencia cuántica con sus promesas vagas, es que estamos sobrevalorando lo que la tecnología puede hacer realmente. Gigantes como OpenAI atraen miles de millones, humanoides se forman con grabaciones hechas en apartamentos, y benchmarks viejos intentan medir algo que cambia constantemente. ¿Estamos preparando el terreno para una nueva generación de máquinas o solo soplando burbujas mientras asustamos a medio planeta?

La tecnología no es una caja mágica donde todo avanza linealmente. Es un caos con talento: errores, discusiones éticas, avances y retrocesos. Por eso, la propuesta de evaluar la IA en contextos reales y colaboración con humanos no debería ser una idea radical, sino el estándar para evitar tropezar con los mismos problemas otra vez.

De momento, Zeus sigue grabando sus tareas. Y tú, ¿seguirías enseñándole a un robot cómo vivir tu día?

Artículos Relacionados

The Pentagon is planning for AI companies to train on classified data, defense official says

Más información sobre Shifting to AI model

Descubre the download: ai health tools and the pentagon’s anthropic culture war