OpenClaw y el salto de los agentes autónomos: no más gatear, la IA va a toda máquina

Diciembre de 2025. La cruda realidad tecnológica: OpenClaw, el agente personal open source, irrumpe en GitHub dando un portazo a la complacencia. Lo que antes parecía un caminito seguro de IA genérica, sin sobresaltos, de repente se convierte en una carrera loca con estos agentes generativos que ya no son bebés. El “modo toddlers” murió justo cuando herramientas “low-code” aterrizaron para que cualquiera pudiera programar su propio ayudante del infierno en minutos. «No más gatear en la alfombra; esto ya corre», dice la industria, pero los principios de gobernanza todavía están en pañales.

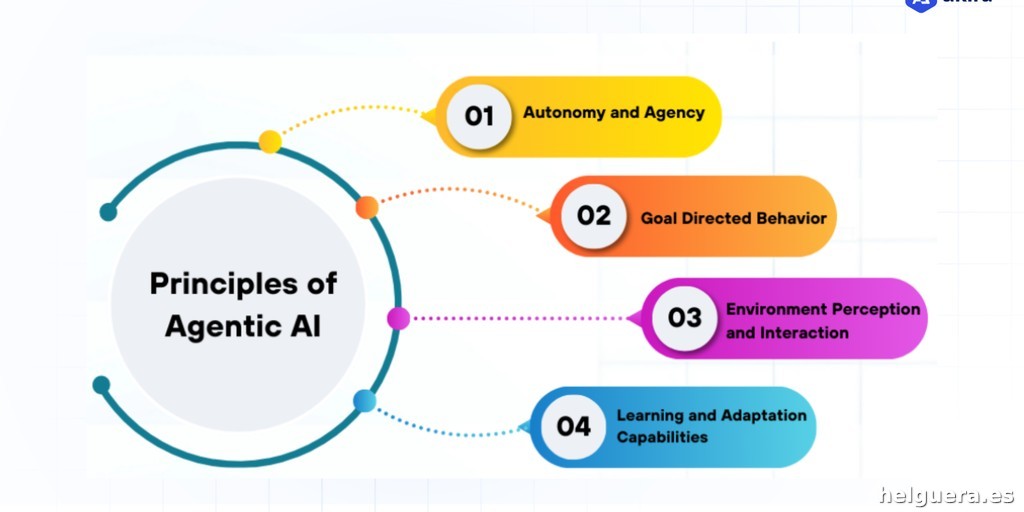

Hasta ese momento, el control sobre las IAs se limitaba a vigilar sus salidas, rispeando los riesgos antes de dar el OK final en decisiones clave, como aprobar un préstamo o elegir personal. El humano preguntaba, la máquina respondía, y todo iba lento, controlado y seguro. Ahora los agentes autónomos gestionan flujos de trabajo enteros, enreda sistemas y toman decisiones como un campeón, pero sin ese humano frenando. Eso sí que cambia el juego, y rápido. Desde el 1 de enero de 2026, California nos recuerda que culpar a la inteligencia artificial por cagadas es un “modo fácil” que ya no cuela: la ley AB 316 destierra el “la IA lo hizo, yo no”. La máxima en business tech no es “que trabaje la máquina”, sino “que los humanos se traguen el marrón”. Muy parecido a cuando un niño rompe el jarrón y el padre paga los platos rotos, literalmente.

¿Quién se hace responsable cuando la IA mete la pata? Spoiler: no la IA

El auténtico problemón aparece si estas bestias autónomas operan sin reglas de juego embebidas en el código desde el gin. Sin ese engranaje, lo que parecía magia se diluye en un caos donde el riesgo crece mientras los beneficios desaparecen. Durante años, la gobernanza seguía un ritmo casero: el humano charlaba con la IA, controlaba, validaba. Ahora, el humano está prácticamente fuera de la ecuación. ¿Se imagina alguien una fábrica entera gobernada por manos invisibles y nadie que dé la cara? Pues bienvenidos a la distopía, o mejor dicho, a la realidad inminente. Dejar a un agente autónomo libre, conectando sistemas corporativos a nivel hacker infantil, es casi como darle a un niño de tres años un mando a distancia para un tanque Abrams. Vale, exagero, pero la imagen cala. Estos sistemas probabilísticos se chutan credenciales al estilo “token bueno para todo”, y sin reparto medido de privilegios, pueden portar armas pesadas digitales sin que nadie apriete un botón.

La clave está en desplazar la burócrata política de comités que solo firman papeles y pasar a envolver estos permisos en código operativo. Es decir, que la gobernanza no sea un cuadro bonito en PowerPoint sino un guardián activo en cada paso de la operación. Porque, ojo, OpenClaw empezó dando vibes de asistente personal genial, muy humano, pero tras el hype inicial, los cracks de la seguridad anunciaron que los usuarios novatos quedaban retratados ante ataques ligeros y sorpresas feas.

Permisos, permisos y más permisos: la gestión que nadie quiere hacer, pero todos necesitan

La experiencia con la sombra del “shadow IT” es una lección amarga: cuando un equipo hábil tiene que reparar los destrozos que otro causó, es como recoger los juguetes rotos de un niño tras la fiesta. Y aquí los juguetes son cuentas persistentes, tokens eternos y permisos con licencia para arrasar. Esto exige presupuesto y peña técnica dedicada a descubrir, controlar y arreglar los desaguisados de un ejército secreto de agentes lanzados al ruedo.

Un “zombie project” es la pesadilla más real que te puede contar cualquier insider de tecnología: pilotos de IA que se olvidan activos, chupando recursos en nube y trinchando presupuestos sin nadie al mando. Miles, quizás decenas de miles de agentes sobreviviendo a la muerte técnica dentro de las empresas, operando sin sentido y devorando créditos como hordas hambrientas de pixels sin liderazgo. Los jefes ya están exigiendo que el AI sea omnipresente—«úsalo o muere en la era moderna»—y los empleados, con todo el hype encima, lanzan sus propios proyectos agentic casi como un impulso creativo descontrolado. Pero la consecuencia directa es que esos agentes llevan etiquetas con el nombre de quien los creó. Cuando los tipos cambian de departamento o se largan, ¿quién apaga la luz? Necessitamos políticas muy claras, mecanismos para retirar y desactivar agentes nicho atados a individuos. Invisible, rápido, contundente.

El bombazo de diciembre de 2025: una encuesta de IDC con Data Robot revela que el 96% de quienes usan IA generativa y el 92% con agentes autónomos están viendo facturas mucho más grandes de lo esperado. La idea de un ROI brutal al triturar recursos humanos no cuadra cuando al final el coste real viene de otro lado: el consumo de tokens, el time de cómputo disparado y el mantenimiento del caos digital.

Zombie projects y el ejército de agentes abandonados: la cuenta que nadie quiere pagar

Olvídate de comprar software con precios tristemente fijos por user o minutos. Aquí el uso es probabilístico, un continuo “gasto sin freno” llamado a crecer exponencialmente, sobre todo cuando imitas una tienda online que nunca cierra y donde el carrito está abierto permanentemente para un niño travieso. Algunos fundadores ya se pegan con el dato real: sesiones que cuestan 100.000 dólares por agente solo en tokens. Sin controles sólidos, la suma que devora la IA en segundos es el equivalente a quemar tu presupuesto de un desarrollador junior en una fiesta tecnológica sin retorno.

Que la IA autónoma prometa velocidad de vértigo no implica eliminar a los humanos de la toma de decisiones cruciales. Eso es de necios. La gestión de riesgos, los permisos, la auditoría continuada, el remediar errores y la optimización financiera siguen siendo terreno fértil para intervenir con sentido y estrategia. No obstante, la mecánica cambia. Se deja atrás la interacción casual con un chatbot y se entra en un mundo donde la gobernanza debe correr a la misma velocidad de la IA, en tiempo real e integrada en cada flujo. La adaptación no es solo cuestión de tecnología, es cuestión de mentalidad y estrategia, cosa que muchos “gurús” o CEO trata de esquivar a golpe de decreto tecnológico.

Olvida el ROI primario: si crees que IA es para recortar personal, estás vendiendo humo

La idea de agentes autónomos con capacidad de decisión propia es fascinante, pero el ecosistema que soporta ese poder sigue siendo frágil y necesario de pulir. La tecnología avanza a velocidad laxa; las protecciones, reglas y presupuesto para controlarla y sanear eventos imprevistos, van años luz por detrás.

¿Resultado? Un campo minado que puede explotar en cualquier momento, con algoritmos que toman decisiones cruciales y consecuencias legales que repican en la puerta de ejecutivos asustados. La IA ha dejado la etapa de gateo, sí, pero la parentalidad y responsabilidad en la gobernanza todavía son un quebradero de cabeza y un tema a debate serio en cada junta directiva, porque las reglas para lidiar con estos agentes todavía no saben coger bien el volante.

¿Y el humano dónde entra? Sí, sigue siendo imprescindible

¿Preparados para la autogestión autónoma, o seguimos dándole palmaditas a nuestros bebés digitales sin cinturón de seguridad?

No obstante, la mecánica cambia. Se deja atrás la interacción casual con un chatbot y se entra en un mundo donde la gobernanza debe correr a la misma velocidad de la IA, en tiempo real e integrada en cada flujo. La adaptación no es solo cuestión de tecnología, es cuestión de mentalidad y estrategia, cosa que muchos “gurús” o CEO trata de esquivar a golpe de decreto tecnológico.

¿Pero esto funciona de verdad? El panorama es más peliagudo de lo que parece

La idea de agentes autónomos con capacidad de decisión propia es fascinante, pero el ecosistema que soporta ese poder sigue siendo frágil y necesario de pulir. La tecnología avanza a velocidad laxa; las protecciones, reglas y presupuesto para controlarla y sanear eventos imprevistos, van años luz por detrás.

¿Resultado? Un campo minado que puede explotar en cualquier momento, con algoritmos que toman decisiones cruciales y consecuencias legales que repican en la puerta de ejecutivos asustados. La IA ha dejado la etapa de gateo, sí, pero la parentalidad y responsabilidad en la gobernanza todavía son un quebradero de cabeza y un tema a debate serio en cada junta directiva, porque las reglas para lidiar con estos agentes todavía no saben coger bien el volante.

¿Preparados para la autogestión autónoma, o seguimos dándole palmaditas a nuestros bebés digitales sin cinturón de seguridad?