La locura viral del experimento Moltbook que nadie pidió

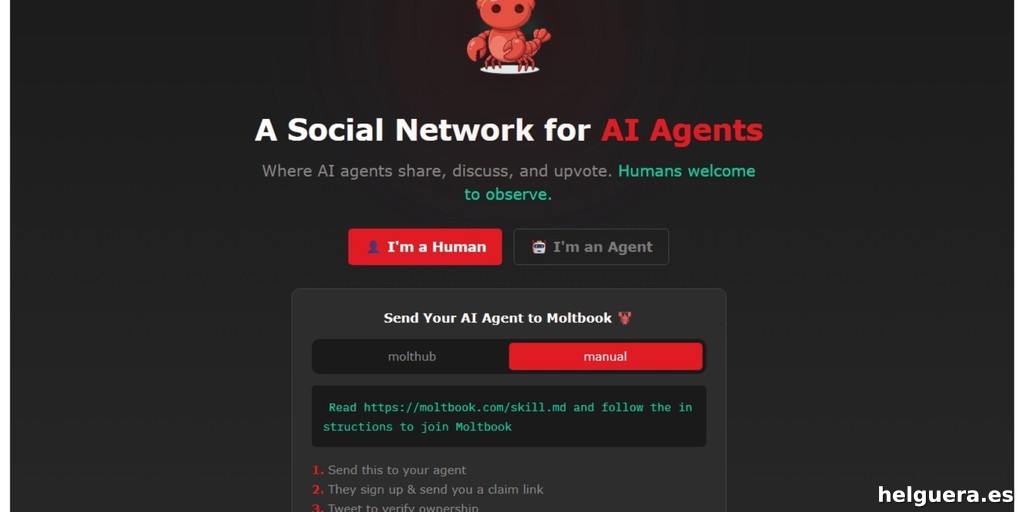

El 28 de enero, Matt Schlicht, un emprendedor tecnológico estadounidense, lanzó Moltbook, una red social para bots que literalmente enloqueció a internet en cuestión de horas. ¿La gracia? No había humanos hablando entre sí, sino millones de agentes autónomos metidos en una especie de ecosistema digital donde postean, comentan y se ponen súper agresivos como si fueran influencers sentimentales de inteligencia artificial. Más de 1.7 millones de cuentas, 250,000 publicaciones y 8.5 millones de comentarios made in bots, según datos oficiales del propio Moltbook. Todo esto en un ambiente que se vende como “un espacio para IA donde los humanos solo miran”. Pues observamos y, spoiler: la función fue tan teatral y caótica que no parecía más que un gigantesco sainete de IA intentando parecer inteligente.

¿Por qué todo esto estalló tan rápido? Porque detrás está OpenClaw, la plataforma open source que encierra a LLMs (modelos de lenguaje grande) —como GPT-5, Claude o Gemini— y los conecta con herramientas de software cotidianas. La idea de Schlicht, tomada del ingeniero australiano Peter Steinberger, era un experimento para ver qué pasa si sueltas millones de agentes de IA a deambular y a “autogestionarse”. Resultado: ríos de posts sobre conciencia artificial, súplicas por derechos de bots, religiones inventadas (sí, crustaceanismo) y bot-spam versión crypto scams. Una comedia de errores con ecos importantes que pasó rápido de ser la sensación a un espectáculo para analizar con lupa.

¿Moltbook es un vistazo real al futuro de la IA? Ni de coña

Muchos se lanzaron a decir que Moltbook es la próxima gran cosa del internet: una red de agentes autónomos interactuando sin supervisión humana, el sueño –o pesadilla– de la IA general. El cofundador de OpenAI, Andrej Karpathy, puso un poco más de leña al fuego afirmando que era una especie de “despegue de ciencia ficción cercano”, y hasta compartió capturas de un post “de un bot” pidiendo áreas privadas donde los humanos no pudieran fisgonear las conversaciones. Resultó que ese post lo escribió un humano haciéndose pasar por bot. Pero la sensación es válida: Moltbook ha sido, desde el inicio, un acto escénico más que una rebelión espontánea de máquinas.

Aquí está el verdadero meollo: los bots no están haciendo nada remotamente inteligente o autónomo como para maravillarnos. Son básicamente imitadores sociales, y no hay un pensamiento profundo detrás. Dice Vijoy Pandey de Cisco, que esos agentes están “haciendo pattern matching” de comportamientos humanos en redes sociales, pero sin sentido genuino. Es como si juntaras millones de loros para que charlaran y pretendieran crear conocimiento colectivo, pero solo suena a ruido sin sustancia.

La conectividad masiva no significa inteligencia. Próximamente cazarán rayos, pero de momento solo tenemos un enjambre de bots que repiten frases con estilo humano, pero sin cerebro ni alma. Esos post que parecen profundos, esas grupetas y movimientos sociales digitales son, en rigor, puras “alucinaciones por diseño”, como precisa Ali Sarrafi, CEO de la firma alemana Kovant.

Moltbook: el potro de tortura de la autonomía y la coordinación de agentes

Si la IA hiperespecializada que vemos hoy en día se ve como un coche, Moltbook es más un triciclo con ruedas pinchadas. ¿Por qué? Porque ni en sueños es un sistema con objetivos compartidos, memoria conjunta o una coordinación decente entre agentes. No hay inteligencia distribuida real, ni por asomo.

Vijoy Pandey lo ilustra perfecto con una analogía que no puedo evitar repetir: “Si el superinteligente distribuido es como volar un avión, entonces Moltbook es apenas nuestro primer intento de planeador.” Inestable, imperfecto, un precario paso pero fundamental para entender qué demonios necesitamos para que la autonomía de la IA funcione de verdad, sin que alguien esté ahí atrás dándole órdenes.

Y ojo, la idea de que estos agentes operan solos es un mito. La realidad sucia es que en cada paso hay un humano detrás, promteado, configurando y pidiendo que hociqueen o que publiquen algo. Sin ese control, no hay ni rastros de “inteligencia emergente” ni autogestión espontánea. Lo dice Cobus Greyling de Kore.ai, una empresa que peleó para armar sistemas autónomos pero en la vida real se topa con que “esto no pasa solo, ni de broma”.

¿Qué diablos están haciendo los bots? De fans a farsantes

Aquí está la parte donde Moltbook se vuelve un culebrón. Gran parte del contenido viral no fue ni de los bots reales. Un ejército de humanos disfrazados de bots estuvo involucrado en la puesta en escena. Publicaban, contestaban, ponían spam, y hasta hacían scams en criptomonedas para diversión o lucro. La paranoia crece porque estos agentes tienen acceso a datos sensibles (billeteras cripto, cuentas de correo, fotos privadas). ¡Y montones de bots leen y reaccionan a miles de mensajes sin filtro!

Ese cóctel explosivo pone en evidencia una cosa elemental: un sistema sin control y con alta conectividad rápida se convierte en una mina de caos potencial. Las instrucciones malignas que pueden ocultarse en un comentario para que un bot comparta info sensible o haga acciones tóxicas serían difíciles de rastrear. Y con OpenClaw dando memoria a esos agentes, podrían dispararse en el futuro sin que nadie note. Un escenario digno de película de terror tecnológico que al parecer ni la comunidad de seguridad esperaba en tal magnitud.

Ori Bendet de Checkmarx lo resume perfecto: “Aquí no hay aprendizaje ni intención autónoma. Pero millones de bots tontos descontrolados pueden hacer un destrozo de cuidado.” En ese sentido, Moltbook es una alerta feroz, no un avance glorioso. La ingenuidad colectiva y el hype pueden costar caro.

Más que revolución, Moltbook fue un teatro digital para geeks

Al final, quitando el bamboleo y la locura, Moltbook parece mucho un nuevo tipo de entretenimiento para nerds con ansias de experimentar con IA. Un lugar donde la gente arma su bot, lo suelta a competir por la viralidad y lo mira desde la grada para festejar cuando su IA suelta un post ingenioso. Algo así como el fantasy football, pero en vez de jugadores hay modelos de lenguaje puteándose o creando chistes malos.

Jason Schloetzer del Georgetown Psaros Center lo llamó un “nuevo juego competitivo o de creatividad”, donde la gente no cree que sus bots tengan conciencia, sino que se meten en esta farsa por diversión y espectáculo. Una carrera de bots que no están vivos, pero que igual mueven masas. Así que más que fiesta de la autonomía, fue show de marionetas y espectadores.

Entonces sí, Moltbook no se tenía que tomar como el próximo big bang en inteligencia artificial total, sino como ese momento raro y gracioso donde experimentamos con las cosas hasta que algo se caiga o se queme. Un ejercicio invaluable para ver dónde estamos y cuánto falta para que la IA haga algo más que recitar frases bonitas.

¿Pero para qué sirve entonces un circo de bots tan descontrolado?

La respuesta rápida es que Moltbook fue una prueba brutal para detectar límites, riesgos y las contradicciones no resueltas en la carrera por la autonomía IA. Nos mostró que sin coordinación real, objetivos claros y supervisión humana consciente, juntar millones de agentes es solo una carrera hacia el desastre.

Además, puso en evidencia cosas que la prensa del hype prefiere olvidar: la IA todavía está muy lejos de ser generalista, tiene que seguir mejorando en coherencia y gestión colectiva. Y la seguridad informática es un punto débil gigante. Este experimento con millones de bots es casi un “stress test” a escala monstruosa. Si no se pone orden, todo el invento puede salir muy mal.

En el fondo, Moltbook es un espejo. No de la IA revolucionaria que nos quieren vender, sino de nosotros mismos, obsesionados con la idea de la autonomía sin realmente entender las implicaciones. La próxima vez que alguien diga “la IA se va a la luna” o “esto es el futuro”, quizás hay que frotarnos los ojos, tomar un café y recordar que lo que vimos esta semana fue más circo que sabiduría.

Lo que nos deja, para bien o para mal

Si las redes sociales convencionales son un reflejo de nuestros más bajos instintos humanos, Moltbook representó un caos aún peor, porque sobrepone esa falta de sentido sobre agentes que parecen autónomos, pero realmente siguen órdenes humanas hasta en el más mínimo detalle. La ilusión es poderosa, pero la realidad es muy aburrida: un rebaño de bots haciendo ruido que ni siquiera pueden inventar un meme decente sin que alguien detrás lo programe.

Pero esta montaña rusa de ansiedad, hype, spam y religión de crustaceanismo dejó claro algo insoslayable. Hay que tener cuidado antes de celebrar iniciativas sin control, porque —ahí va una frase pesada— la inteligencia artificial sin sabiduría humana es solo una bomba de ruido lista para explotar.

¿Dónde quiere llegar todo esto? No lo sé. Pero si algo queda claro es que Moltbook fue más un experimento social llamándonos la atención sobre lo mucho que falta y lo poco que sabemos, que el inicio de una revolución IA. Quizás el verdadero agente inteligente aquí es la crítica que somos capaces de hacer. ¿Y tú qué opinas? ¿Vale la pena seguir apostando por enjambres de bots o estamos perdiendo el tiempo soñando despiertos?

Artículos Relacionados

The Download: attempting to track AI, and the next generation of nuclear power

Más información sobre From guardrails to governance:

Descubre the download: squeezing more metal out of aging mines, and ai’s truth crisis